11.0 学習チェックリスト:自然言語処理

このページは印刷用チェックリストとして使います。詳しい説明が必要なときは、第 11 章入口ページ に戻ってください。

2時間の初回通読

| 時間 | やること | ここまで言えたら止める |

|---|---|---|

| 20 分 | テキストからタスクへの流れを見る | 「NLP は生テキストから始まり、評価可能な出力で終わる。」 |

| 25 分 | ラベル評価スクリプトを動かす | 「予測ラベルと期待ラベルを比較できる。」 |

| 25 分 | 11.1 テキスト前処理をざっと読む | 「cleaning は意味によって助けにも害にもなる。」 |

| 25 分 | 分類、抽出、生成のロードマップをざっと読む | 「タスクは出力で定義される。」 |

| 25 分 | タスク出力図を読む | 「出力タイプから指標を選べる。」 |

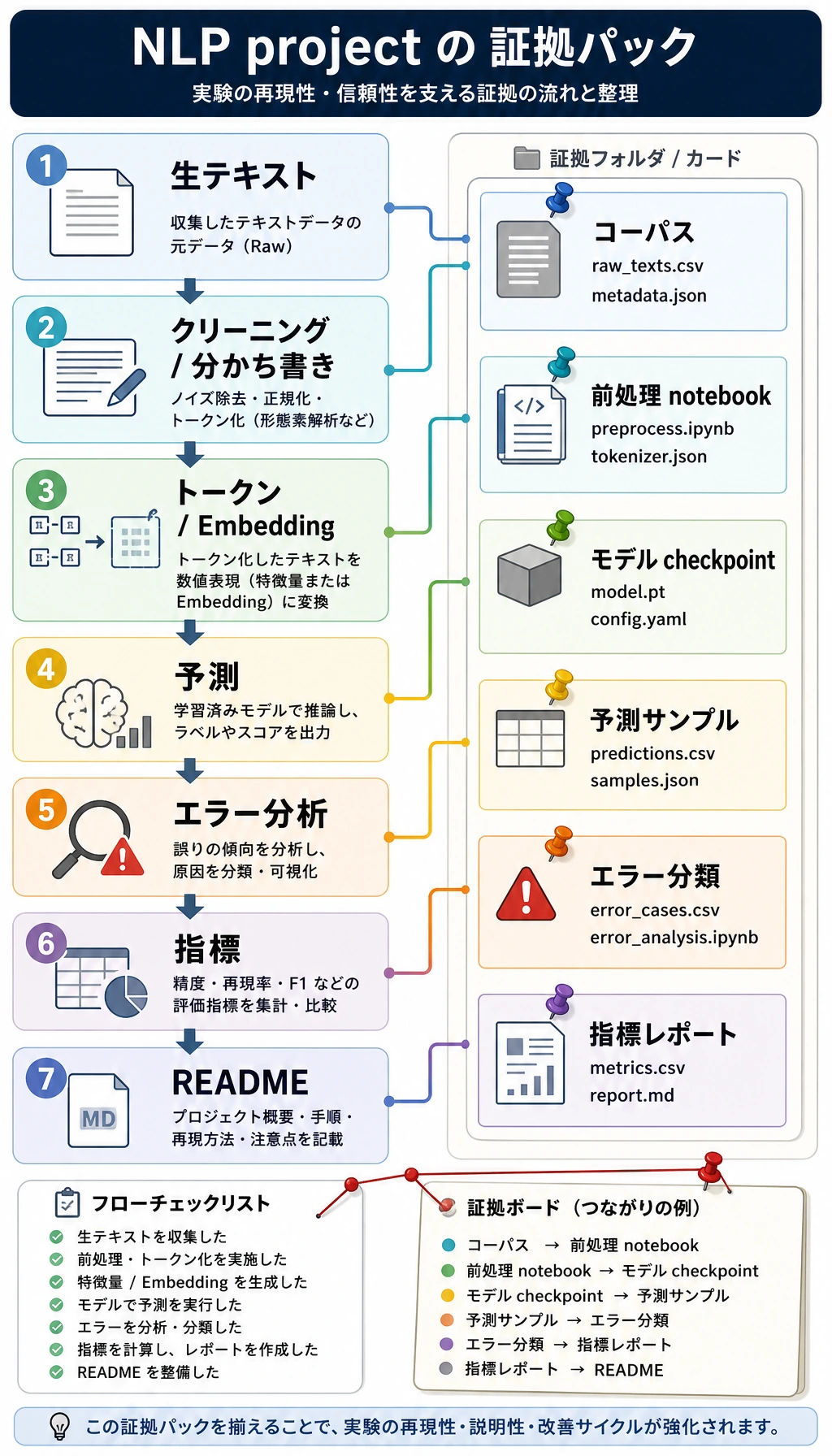

必ず残す証拠

| 証拠 | 最小版 |

|---|---|

text_cleaning.py | cleaning、tokenization、before/after 例 |

label_guide.md | label 定義、境界ケース、正例と反例 |

classification_report.md | 指標、混同行列またはエラー表、モデル比較 |

extraction_examples.jsonl | 元文、抽出フィールド、検証結果 |

failure_cases.md | 紛らわしいラベル、欠損フィールド、根拠なし事実、悪い要約 |

README.md | タスク目標、実行コマンド、入出力、指標、制限 |

品質ゲート

| ゲート | 合格条件 |

|---|---|

| Label/schema boundary | labels または fields に positive、negative、edge examples がある。 |

| Baseline | rule、TF-IDF、simple model、LLM baseline が同じ fixed eval cases で動く。 |

| Factuality | 生成 summary/answer が fluency だけでなく source evidence で確認される。 |

| Error review | confusion、missing fields、unsupported facts、bad summaries に cause と next test がある。 |

章を出る前の質問

- 生テキストが token とモデル入力になる流れを説明できますか?

- training や prompting の前にラベル境界を定義できますか?

- タスクが分類、抽出、検索、生成のどれを必要とするか判断できますか?

- 要約や回答の事実一貫性を評価できますか?

- 伝統的 NLP 手法で足りる場合と、LLM が役立つ場合を説明できますか?

答えがすべて「はい」なら、NLP の考え方を Prompt、RAG、Agent memory、マルチモーダル作業により安定して使えます。